开源启动!18个月Llama系列下载量近3.5亿,黄仁勋:快到难以置信

开源启动!18个月Llama系列下载量近3.5亿,黄仁勋:快到难以置信今天一大早,Meta 便秀了一把「Llama 系列模型在开源领域取得的成绩」,包括如下:

搜索

搜索

今天一大早,Meta 便秀了一把「Llama 系列模型在开源领域取得的成绩」,包括如下:

最近,Meta的多个工程团队联合发表了一篇论文,描述了在引入基于GPU的分布式训练时,他们如何为其「量身定制」专用的数据中心网络。

Meta的开源大模型Llama 3在市场上遇冷,进一步加剧了大模型开源与闭源之争的关注热度。

随着LLM不断迭代,偏好和评估数据中大量的人工标注逐渐成为模型扩展的显著障碍之一。Meta FAIR的团队最近提出了一种使用迭代式方法「自学成才」的评估模型训练方法,让70B参数的Llama-3-Instruct模型分数超过了Llama 3.1-405B。

Meta加强推广Llama模型,谋求AI市场领导

微软Phi 3.5系列上新了!mini模型小而更美,MoE模型首次亮相,vision模型专注多模态。

小模型崛起了。

发布40天后,最强开源模型Llama 3.1 405B等来了微调版本的发布。但不是来自Meta,而是一个专注于开放模型的神秘初创Nous Research。

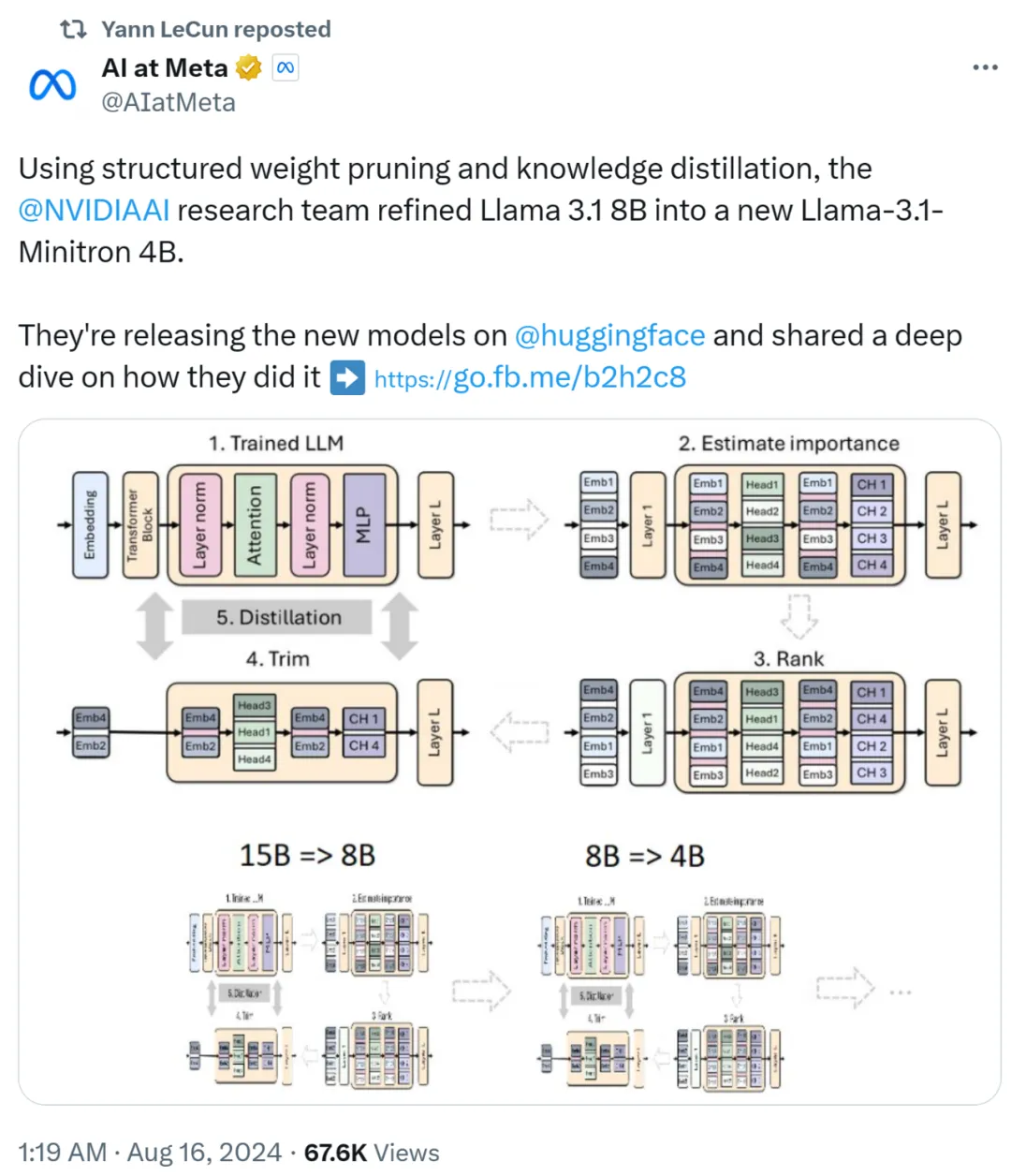

最近的论文表明,LLM等生成模型可以通过搜索来扩展,并实现非常显著的性能提升。另一个复现实验也发现,让参数量仅8B的Llama 3.1模型搜索100次,即可在Python代码生成任务上达到GPT-4o同等水平。

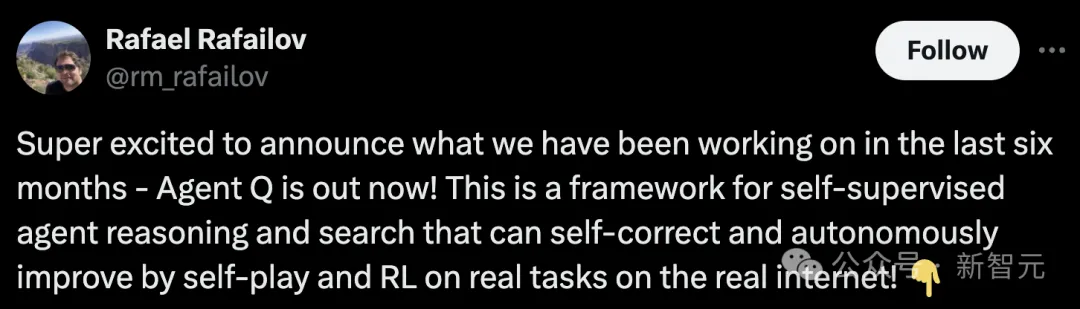

没有等来OpenAI的Q*/草莓项目的发布,一家名为MultiOn初创公司却抢先发布了名为Q的智能体。